Ich habe in letzter Zeit viel über Walter Writes AI gesehen und bin mir nicht sicher, ob es wirklich gut ist oder nur gehypt wird. Ich suche nach ehrlichem Feedback zur Schreibqualität, zum Preis, zur Zuverlässigkeit und dazu, wie es im Vergleich zu anderen KI‑Tools abschneidet. Wenn du es für Blogs, Werbetexte oder Kundenprojekte genutzt hast, kannst du deine Erfahrungen teilen und sagen, ob du es weiterempfehlen würdest?

Walter Writes AI Rezension aus der Sicht von jemandem, der ein Wochenende lang versucht hat, es kaputtzumachen

Walter Writes AI: wie die Tests aussahen

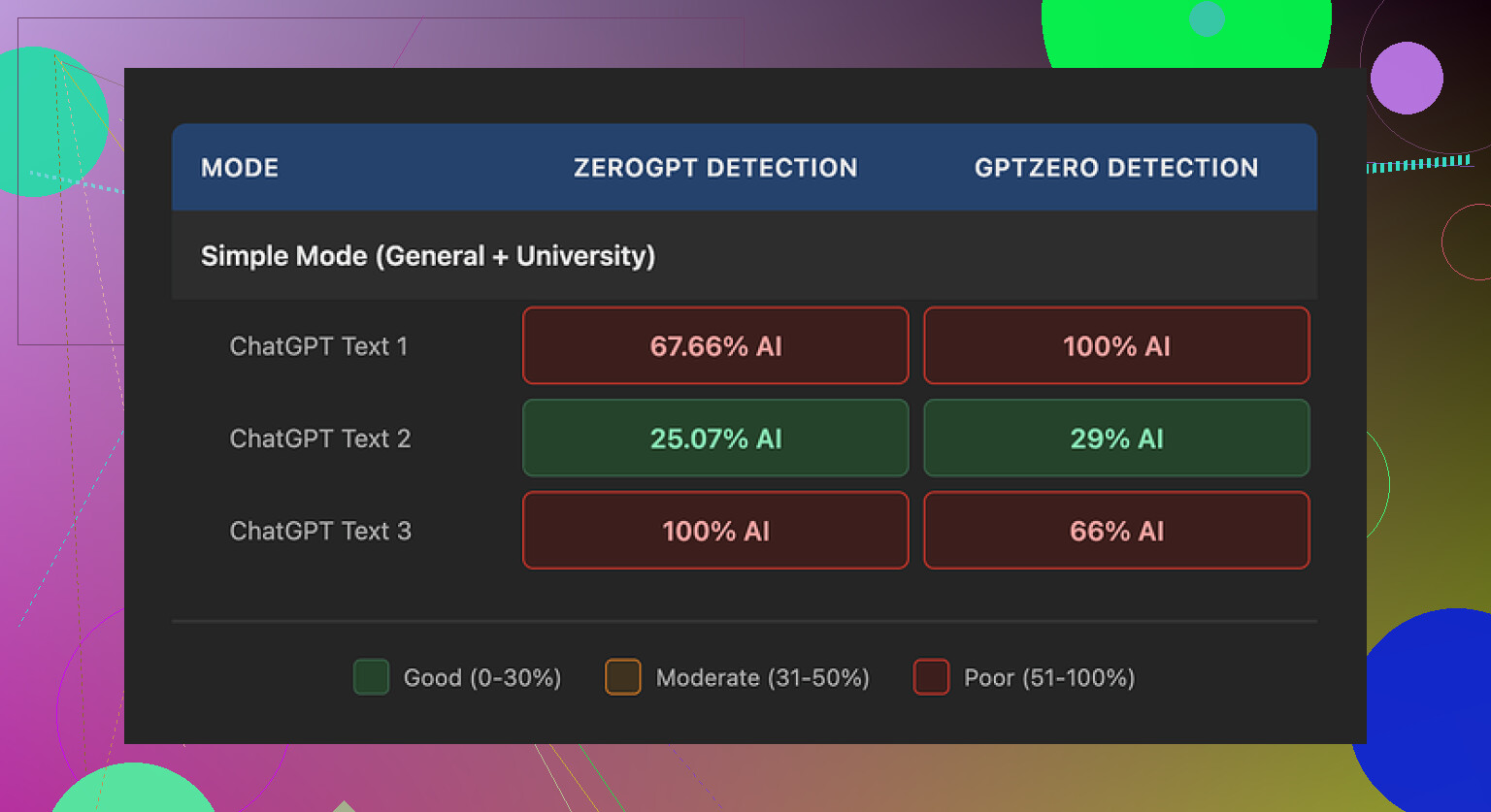

Ich habe eine Reihe kurzer Textproben durch Walter Writes AI laufen lassen und die Ergebnisse dann durch ein paar Detektoren gejagt, hauptsächlich GPTZero und ZeroGPT.

Ein Durchlauf sah solide aus. GPTZero zeigte 29 Prozent KI, ZeroGPT 25 Prozent KI. Für einen Lauf im Free-Tier ist das besser als vieles, was ich bei zufälligen „Free Humanizer“-Seiten gesehen habe, die überall gespammt werden.

Dann wurde es seltsam. Die anderen beiden Proben landeten bei mindestens einem Detektor bei 100 Prozent KI. Gleiches Tool, gleicher Simple-Modus, gleicher Typ Ausgangstext, unterschiedliche Läufe. Fühlte sich zufällig an, nicht verlässlich.

Wichtiger Punkt: Ich hatte nur Zugriff auf den kostenlosen Simple-Modus. Es gibt zwei höhere Stufen, Standard und Enhanced, die hinter einem Abo gesperrt sind. Diese sollen ein stärkeres Bypass-Verhalten haben. Ich habe sie nicht getestet, also kannst du mit Abo eventuell bessere Werte sehen, aber ich würde nicht darauf wetten.

Screenshot des Durchlaufs

Wie der Text für Menschen wirkte, nicht für Detektoren

Wenn man die Scores kurz ausblendet, wirkte der Text selbst auf eine Art merkwürdig, die Detektoren nach und nach zu erkennen lernen.

Das ist mir aufgefallen:

-

Seltsamer Semikolon-Spam

Es hat ständig Semikolons gesetzt, wo eine normale Person Kommas nehmen oder den Satz trennen würde. Es wirkte, als wäre dieser Stil fest eingebaut. Nach ein paar Absätzen beginnt dein Gehirn, das als „generiert“ zu markieren. -

Wiederholte Füllwörter

In einer Probe tauchte das Wort „heute“ viermal in drei Sätzen auf. Nicht als Betonung, eher wie eine hängengebliebene Floskel. Menschen variieren Formulierungen in der Regel viel stärker, ohne darüber nachzudenken. -

Lehrbuchartige Klammern

Es liebte Muster wie „(z. B. Stürme, Dürren)“ und hat diese Struktur ständig wiederholt. Die Kombination aus „z. B.“ plus zwei ziemlich generischen Beispielen wirkt sehr modelltypisch. Wenn man es einmal sieht, übersieht man es nicht mehr.

Wenn du Text für Leute brauchst, die nur drüberfliegen, kommst du damit vielleicht durch. Wenn du das an eine Redaktion, einen anspruchsvollen Kunden oder irgendwohin schickst, wo Detektoren im Einsatz sind, wirkt es riskant.

Preise im Verhältnis zu Limits

Hier bin ich ausgestiegen.

Preise zum Zeitpunkt meiner Prüfung:

-

Starter-Tarif

8 Dollar pro Monat bei jährlichem Abo.

Rund 30.000 Wörter inklusive. -

Unlimited-Tarif

26 Dollar pro Monat.

Er ist beim Gesamtvolumen „unlimited“, aber jede Eingabe ist auf 2.000 Wörter begrenzt. -

Kostenloser Tarif

300 Wörter insgesamt. Nicht pro Tag, insgesamt. Das reicht für ein paar Testruns, dann war es das.

Das Eingabelimit im „Unlimited“-Tarif ist hart, wenn du längere Reports, Essays, Dokumente oder Buchkapitel bearbeitest. Du müsstest den Text in Stücke teilen, was den Fluss und die Konsistenz der Ausgabe oft kaputtmacht.

Rückerstattung und Umgang mit Daten

Zwei rote Flaggen für mich.

-

Sprache zu Rückerstattungen und Chargebacks

Die Rückerstattungsrichtlinie war mit sehr scharfen Warnungen zu Chargebacks formuliert, inklusive Androhung rechtlicher Schritte bei Streitfällen. Dieser Ton ist in dieser SaaS-Nische eher unüblich und hat mich schnell abgeschreckt. Wenn ein Dienst starke Bindung und Vertrauen hat, verlässt er sich selten auf juristische Drohungen im Refund-Text. -

Datenspeicherung ist vage

Ich habe keine klare, verständliche Erklärung gefunden, wie lange deine Texte gespeichert werden oder was nach der Verarbeitung damit passiert. Wenn du Kundendokumente, akademische Arbeiten, juristische Entwürfe oder sonst etwas Sensibles einfügst, ist das wichtig. Mangelnde Klarheit ist für manche ein K.-o.-Kriterium.

Was für mich besser funktioniert hat

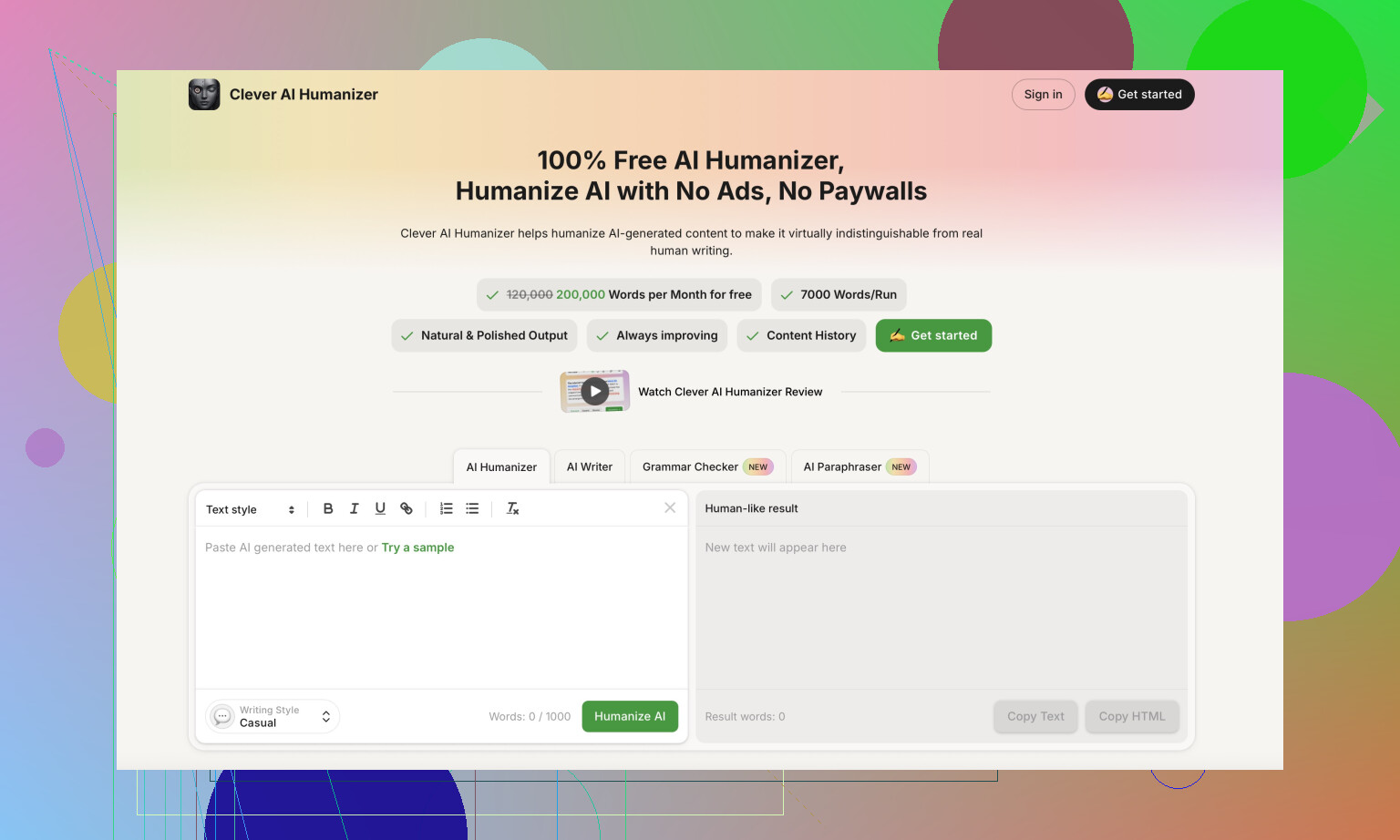

Während der Tests bin ich immer wieder zu Clever AI Humanizer zurückgekehrt, weil die Ausgabe weniger robotisch wirkte und zum Zeitpunkt meiner Nutzung kein Geld verlangte.

Clever AI Humanizer Link:

Für denselben Ausgangstext klangen die Ergebnisse von Clever näher an dem, wie ich schreibe, wenn ich müde bin und einfach klar sein will – genau das, was man haben möchte. Kürzere Sätze, weniger seltsame Muster, weniger Übererklärungen.

Wenn du etwas Kontext und Feedback aus der Community möchtest, gibt es ein paar Threads und ein Video, die sich lohnen:

Humanize AI Tutorial auf Reddit

Clever AI Humanizer Review auf Reddit

YouTube Videoreview

Grobe Einschätzung aus meinen Durchläufen

Wenn du Walter Writes AI im Free-Tier testest, solltest du mit inkonsistenten Detektorwerten und auffälligen Stilbrüchen rechnen, die einem ins Auge springen, sobald man sie erkennt. Die höheren Bezahlstufen könnten besser abschneiden, aber wegen Preisstruktur, Eingabelimits, Haltung zu Rückerstattungen und unklarer Datenspeicherung habe ich für alles Wichtige Clever AI Humanizer genutzt und Walter nur aus Neugier weiter ab und zu ausprobiert.

Kurze Version aus meinen Tests und dem, was andere wie @mikeappsreviewer gesehen haben: Walter Writes AI ist so lala und etwas überteuert für das, was man bekommt.

Hier die Aufschlüsselung.

- Schreibqualität

- Die Ausgaben lesen sich wie mittelmäßiger KI‑Text.

- Ich habe auch seltsame Zeichensetzung und wiederholte Formulierungen gesehen.

- Beim schnellen Überfliegen wirkt es okay, aber wer genau liest, merkt, dass etwas nicht stimmt.

- Wenn dir Ton oder Persönlichkeit wichtig sind, musst du immer noch viel nachbearbeiten.

- Leistung bei KI‑Detektoren

- In meinen Durchläufen schwankten die Detektorwerte stark.

- Manchmal waren die Werte ordentlich, ein anderes Mal wurde der Text klar als KI markiert.

- Diese Zufälligkeit macht es riskant, wenn dein Hauptziel das Umgehen von KI‑Detektoren ist.

- Die höheren Pläne sind vielleicht besser, aber die Gratis‑Stufe hat mir nicht genug Vertrauen gegeben, um zu zahlen.

- Preise und Limits

So ungefähr sah es in meinen Tests aus:

- Starter rund 8 pro Monat, 30k Wörter.

- „Unbegrenzt“ im mittleren 20er‑Bereich pro Monat, aber jede Eingabe auf 2k Wörter begrenzt.

- Die kostenlose Stufe ist winzig, nur für kurze Tests brauchbar.

Wenn du lange Aufsätze, Berichte oder Kapitel schreibst, nervt diese 2k‑Grenze schnell. Du musst den Text aufteilen, was den Fluss zerstört und Konsistenz schwerer macht.

- Zuverlässigkeit und UX

- Die Seite funktionierte, aber ich hatte ein paar langsame Antworten und einen Timeout.

- Keine klaren Infos dazu, wie lange deine Texte auf ihren Servern bleiben.

- Die Formulierungen zur Rückerstattung wirkten aggressiv. Viele Drohungen in Richtung Chargebacks. Das ist ein schlechtes Zeichen für ein kleines SaaS‑Tool in dieser Nische.

- Vergleich mit anderen Tools

- Für reines Schreiben hat mir ein normaler GPT‑Chatbot plus leichte manuelle Nachbearbeitung sauberere Texte geliefert.

- Für das „Vermenschlichen“ von KI‑Text war Clever AI Humanizer in meinen Tests besser. Weniger robotische Formulierungen, weniger seltsame Muster, und es klang mehr so, wie ein müder, aber normaler Mensch schreiben würde.

- Wenn du Text willst, der direkt für Kunden oder Dozenten taugt, würde ich mich nicht allein auf Walter verlassen.

- Für wen es passt

Nutze Walter Writes AI, wenn:

- Du einfach experimentieren willst.

- Du nur kurze, wenig kritische Texte brauchst.

- Es dich nicht stört, viel nachzuredigieren.

Lass es bleiben und schau dir Clever AI Humanizer oder ein Standard‑LLM an, wenn:

- Dir konsistente Detektorwerte wichtig sind.

- Du lange Dokumente bearbeitest.

- Du dir Sorgen um Datenhandling oder Stress wegen Rückerstattungen machst.

Wenn du es ausprobierst, bleib zuerst beim Gratis‑Plan, lass denselben Text mehrfach laufen und vergleiche dann Ausgaben und Detektorwerte. So merkst du schnell, ob es zu deiner Risikotoleranz und deinem Qualitätsanspruch passt.

Kurzfassung: Walter Writes AI ist kein kompletter Müll, aber weit entfernt von einem „magischen Bypass“ oder einem „schreibenden Menschen auf Augenhöhe“. Es ist sehr Mittelmaß.

So ist es für mich ausgefallen und so ähnlich haben es @mikeappsreviewer und @viajantedoceu wahrgenommen, nur mit leicht anderem Blickwinkel.

1. Schreibqualität

Ich würde es nennen: „generischer KI‑Blog‑Spam mit Marotten“.

- Liest sich wie typischer LLM‑Text, der krampfhaft „weniger KI‑mäßig“ wirken soll, aber nicht auf subtile Art.

- Seltsame Zeichensetzungsgewohnheiten (die angesprochenen Semikolons gibt es wirklich) und sich wiederholende Formulierungen lassen alles sehr schematisch wirken.

- Für belanglose Zwecke ist es nutzbar: schnelle Entwürfe, Fülltexte, Grobgliederungen.

- Für alles, wo Tonfall zählt – Kundenaufträge, Aufsätze, E‑Mails –, wirst du massiv nachbearbeiten. An dem Punkt ist ein normaler Chatbot plus 10 Minuten eigener Feinschliff meist sauberer.

Ich bin nur bedingt bei der Aussage, dass es nur für völlig niedrige Stakes taugt. Wenn dein Publikum sowieso nur überfliegt (Social Posts, kurze Produkttexte), kann man es nutzen, solange du die Merkwürdigkeiten manuell glättest. Unbearbeitet würde ich es aber nicht rausgeben.

2. „Bypass“ von KI‑Detektoren

Genau hier verbrennen sich Leute.

- Das Verhalten ist inkonsistent: Manchmal sind die Scores okay, manchmal schlagen sie voll aus und schreien „KI“.

- Wenn dein Hauptziel das Umgehen von Detektoren ist (Schule, Unternehmensrichtlinien etc.), ist diese Zufälligkeit im Grunde eine Zeitbombe.

- Die Bezahlstufen könnten besser sein, aber jedes Tool, das schon in der Gratisversion kein stabiles Verhalten zeigt, ist für diesen Zweck ein Warnsignal.

Zudem sind die Detektoren selbst wackelig, daher wirkt es wie Geldverbrennung, extra zu zahlen, nur um sie „auszutricksen“, und dann liefert das Tool noch nicht einmal verlässlich.

Wenn du bestehenden KI‑Text wirklich „vermenschlichen“ willst, hat Clever AI Humanizer in meinen Tests spürbar besser abgeschnitten. Der Rhythmus wirkte eher wie ein müder Mensch um 23 Uhr als wie ein Modell, das wie ein Lehrbuch klingen will. Man muss weiterhin nachbearbeiten, aber die Basis ist näher an natürlicher Sprache. Es lohnt sich tatsächlich, „Clever AI Humanizer review“ zu googeln und Beispiele anzuschauen, bevor du dich für irgendetwas festlegst.

3. Preisgestaltung und Gegenwert

Was mich mehr stört als die Qualität, ist das Preis‑Leistungs‑Verhältnis:

- Der Einstiegspreis ist für sich genommen nicht verrückt, aber das Wortlimit wirkt schnell eng, sofern du nicht extrem wenig schreibst.

- „Unbegrenzt“ mit einem Limit von rund 2.000 Wörtern pro Eingabe ist ziemlich albern, wenn du mit langen Dokumenten arbeitest. Alles in Stücke hacken zu müssen zerstört den Fluss und sorgt für merkwürdige Inkonsistenzen.

- Die kostenlose Stufe ist so klein, dass du kaum ein Gefühl für den echten Arbeitsablauf bekommst, bevor du an die Grenze stößt.

Angesichts der Marotten und der schwankenden Detektor‑Ergebnisse wirkt die Preisgestaltung so, als würdest du einen Premiumpreis für ein B‑Klasse‑Tool zahlen.

4. Zuverlässigkeit, Policies und Vertrauensgefühl

Hier gehen bei mir die persönlichen Alarmglocken an:

- Ab und zu langsame Antworten sind egal, aber Timeouts bei einem reinen Texttool sind kein gutes Zeichen.

- Die Formulierungen zur Rückerstattungsrichtlinie sind deutlich aggressiver als nötig. Nutzer mit juristischer Rhetorik bei Rückbuchungen zu bedrohen, wirkt im besten Fall unsicher.

- Der Umgang mit Daten ist nicht in klarer, verständlicher Sprache erklärt. Wenn du Kundendokumente oder akademische Texte einfügst, sollte dich das stören.

Ich bin beim Thema Datenschutz vielleicht vorsichtiger als andere, aber vage Aussagen zu Speicherung / Aufbewahrung plus scharf formulierte Refund‑Texte reichen mir, um alles Wichtige dort fernzuhalten.

5. Im Vergleich zu anderen KI‑Tools

Was für die meisten Leute in der Praxis besser funktioniert:

- Ein normaler GPT‑ähnlicher Chatbot zum Entwerfen und danach manuelle Nachbearbeitung.

- Speziell für KI‑zu‑Mensch‑Umschreibungen ist Clever AI Humanizer einen direkten Vergleich wert. Schick ihm denselben KI‑Text, den du Walter geben würdest, vergleiche den Fluss und schau, unter welchem Ergebnis du deinen Namen eher setzen würdest.

- Wenn du lange Texte schreibst (Aufsätze, Berichte, Kapitel), wird dir praktisch jedes Tool ohne harte Input‑Limits deutlich weniger auf die Nerven gehen.

Ich bin nicht ganz im „Walter ist nutzlos“-Lager, aber beim Urteil „Walter ist meh und überteuert für das, was es ist“ bin ich dabei. Es ist ein Spielzeug aus Neugier oder ein Notfall‑Tool, nichts, worauf ich einen Workflow aufbauen würde.

6. Solltest du es testen?

- Wenn du nur neugierig bist: Nutze die winzige Gratisstufe, probier ein wenig herum, füge nichts Sensibles ein und kauf auf keinen Fall vorschnell einen Jahresplan wegen des Hypes.

- Wenn du verlässlich gute Texte oder detektorsichere Outputs brauchst: Such dir etwas anderes oder nutze eine normale LLM‑Kombi mit Clever AI Humanizer und anschließendem Handschliff.

- Wenn das Budget knapp ist oder viel auf dem Spiel steht (Schule, Job, Kunden): Ich würde Walter derzeit auslassen.

TL;DR: Kein Scam, nur sehr mittelmäßig. Das Marketing ist heißer als das Produkt.

Kurzfassung: Walter Writes AI ist in Ordnung, solange du die Erwartungen niedrig hältst, aber es ist kein geheimer Cheatcode für Schreiben auf Menschen-Niveau oder Immunität gegen Detektoren.

Hier lande ich nach der Lektüre dessen, was @viajantedoceu, @cazadordeestrellas und @mikeappsreviewer geschrieben haben, und nachdem ich ähnliche Tools in meinen eigenen Workflows getestet habe:

Wo ich den anderen leicht widerspreche

Sie sind ziemlich hart in ihrem Urteil über Walters Nützlichkeit. Ich finde, es kann brauchbar sein für:

- schnelle, unwichtige Landingpage-Abschnitte

- einfache Meta-Beschreibungen oder Produkt-Snippets

- Brainstorming alternativer Formulierungen

Wenn du es mit einem starken eigenen Lektorat kombinierst und dir KI-Detektoren egal sind, ist es akzeptabel. Ich würde es nicht komplett als egal bezeichnen, nur als schlecht vermarktet für das, was es realistisch ist.

Trotzdem stimme ich ihnen bei den großen Problemen zu: inkonsistente Detektorwerte, seltsame Zeichensetzungsmuster und grenzwertig knappe Limits für den Preis.

Walter Writes AI vs Alternativen in der Praxis

Wenn du ein Tool auswählst, entscheidest du im Grunde zwischen drei Dingen:

-

Rohes LLM (wie ein normaler Chatbot)

- Am besten für: Qualität und Kontrolle.

- Du schreibst Prompts und überarbeitest dann per Hand.

- Du bekommst flexiblere Tonalität und weniger fest eingebaute Macken als bei Walter.

-

Humanizer-Schicht oben auf KI-Text

- Am besten dafür geeignet, KI-Inhalte weniger robotisch klingen zu lassen.

- In dieser Kategorie versucht Walter mitzuspielen, wirkt aber unausgereift.

-

Hybrider Workflow

- Entwurf mit einem Tool, Humanizing mit einem anderen, Abschluss per Hand.

- Hier ergibt etwas wie Clever AI Humanizer tatsächlich Sinn.

Clever AI Humanizer: schnelle Vor- und Nachteile

Du wolltest ehrliches Feedback, also hier eine neutrale Einschätzung zu Clever AI Humanizer speziell, da mehrere Personen es erwähnt haben.

Vorteile

- Der Textfluss wirkt meist näher an echter, leicht müder, aber kohärenter Menschensprache.

- Weniger seltsame Zeichensetzungstics als das, was viele bei Walter beobachten.

- Gut darin, überlange KI-Sätze in menschlichere, kürzere Einheiten zu zerlegen.

- Funktioniert gut als zweiter Durchgang, nachdem ein normales GPT-ähnliches Modell die Hauptarbeit erledigt hat.

Nachteile

- Noch immer kein Prinzip Schreiben und vergessen. Du musst redigieren, besonders bei Fakten, Quellenangaben oder Nischenthemen.

- Kann gelegentlich zu stark vereinfachen, was schlecht ist, wenn du technische Nuancen brauchst.

- Wie jeder Humanizer bewegt es sich rechtlich und ethisch in einer Grauzone, wenn dein Hauptziel das Umgehen von Detektoren in Schule oder Job ist.

- Detektoren sind volatil, daher kann kein Tool ehrlich 0 Prozent KI-Erkennung versprechen.

Ich glaube nicht ganz, dass Clever AI Humanizer allen anderen haushoch überlegen ist, aber es bietet einen besseren Kompromiss aus Fluss und Lesbarkeit als das, was über Walter Writes AI berichtet wird.

Wann Walter trotzdem sinnvoll sein kann

Nutze Walter Writes AI, wenn:

- Du bereits für einen Monat bezahlt hast und etwas Gegenwert willst: nutze es für Gliederungen, generische Intros oder E-Mail-Entwürfe, die du stark umschreibst.

- Du nur kurze Textstücke bearbeitest und mit Macken leben kannst.

- Detektorwerte nur ein nettes Extra sind, aber keine harte Anforderung.

Lass Walter weg und nutze ein normales LLM plus etwas wie Clever AI Humanizer, wenn:

- Du regelmäßig längere Aufsätze, Berichte oder Kapitel schreibst.

- Du Wert auf einen konsistenten Stil im gesamten Dokument legst.

- Du bei vagen Rückerstattungsregeln oder unklarer Datennutzung ein schlechtes Gefühl hast.

Fazit:

Walter Writes AI ist kein Betrug, aber überhypt und für das, was wie mittelmäßiger, eigenwilliger KI-Output wirkt, etwas zu teuer. Wenn es nicht um viel geht und du ohnehin redigierst, ist es nutzbar. Wenn du einen saubereren, natürlicheren Textfluss für Inhalte willst, die deinen Namen tragen, kommst du mit einem normalen Chatbot plus einem Durchlauf durch Clever AI Humanizer und deinem eigenen Lektorat in der Regel zu besseren Ergebnissen.