我一直在测试 Clever AI Humanizer 工具,用它来重写 AI 内容,让文字听起来更自然、不那么容易被检测出来,但效果有好有坏。有时它能改善行文流畅度和语气,有时又会让内容显得别扭,或者还是一眼就像 AI 生成的。有没有人能分享一些使用这个工具处理长篇内容和 SEO 时的技巧、设置或工作流程,让它表现更好?或者推荐一些更好的替代方案,在不影响排名的前提下,让文本保持更接近真人书写的感觉?

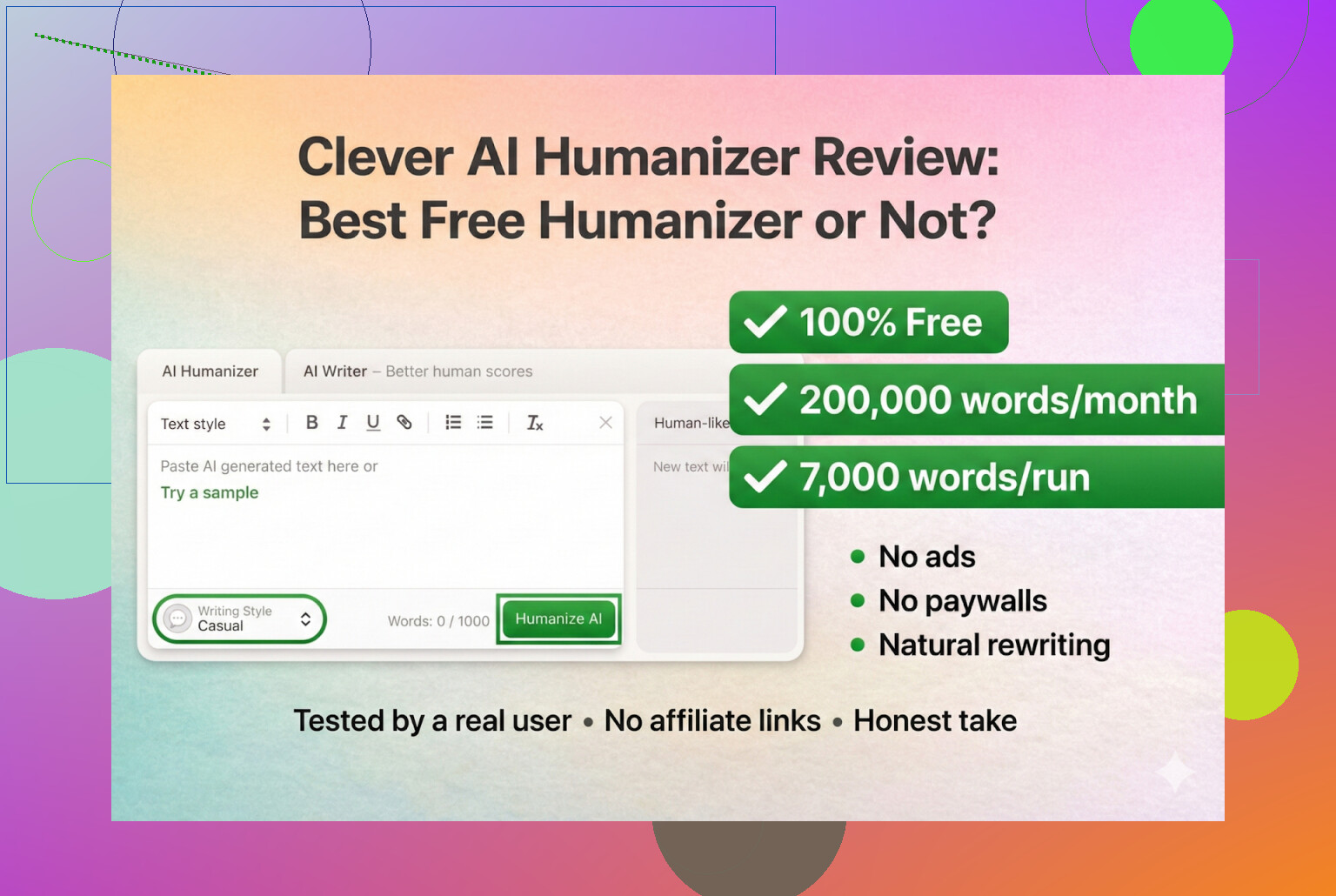

Clever AI Humanizer:我的真实体验与测试结果

我最近一直在折腾各种 AI “人性化处理”工具,从免费的开始试起,而我花时间最多、测试最狠的,就是 Clever AI Humanizer。

这个细分领域变化非常快:工具被推出、修补、重发,然后一旦跟不上新检测器就悄无声息地死掉。所以我想弄清楚的是 Clever AI Humanizer 此刻的实际表现,而不是几个月前某篇博客里的老印象。

真正的 Clever AI Humanizer 链接(因为,没错,确实有假的)

官网地址是:

这是我目前找到的唯一一个靠谱的 Clever AI Humanizer。

之所以特地把链接写清楚,是因为已经有人给我发消息,说被 Google 广告带去了各种山寨站,之后再来问我要“真正的网址”。有些仿冒工具利用这个名字蹭流量,然后给你整订阅、虚假的“高级版”等等。

就我目前看到的情况:

- Clever AI Humanizer 没有付费方案

- 没有各种加价项目,也没有隐藏的“解锁完整版”之类

- 如果有人打着这个品牌名义向你收费,你几乎可以确定进错站了

总之,上站前先看一眼地址栏。

我的测试方法

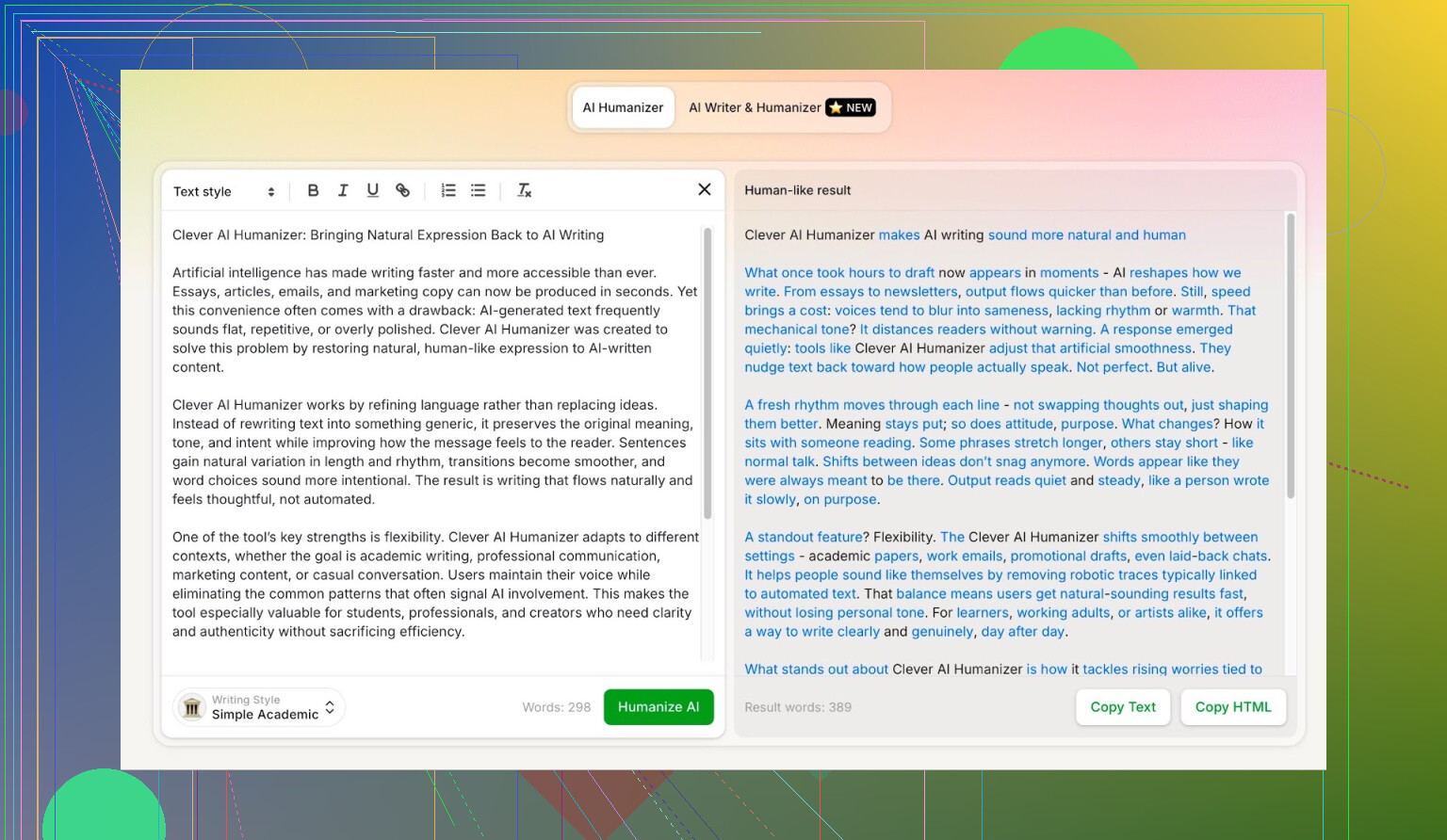

我不想用自己写的草稿来做测试,那样容易有主观偏差,所以干脆搞了个纯 AI 对 AI 的流程:

- 用 ChatGPT 5.2 生成一篇 100% 由 AI 撰写、主题是 Clever AI Humanizer 的文章。

- 把这段原始 AI 文本丢进 Clever AI Humanizer 里做人性化处理。

- 再把结果拿去跑多款 AI 检测工具,然后丢回 ChatGPT 做质量评估。

第一轮测试时,我在 Clever AI Humanizer 里选择的是 Simple Academic(简洁学术) 风格。

这个选项比较有意思,因为:

- 用的是偏学术化的表达,但没有走极端的论文体。

- 这种“介于中间”的风格,对不少检测器来说是个难点。

- 对人性化工具来说,这也是比较难伺候的模式:既要有结构感,又不能写得死板。

我自己的猜测是,这种半正式风格能避开一些检测模式,同时对普通读者来说读起来依然自然。

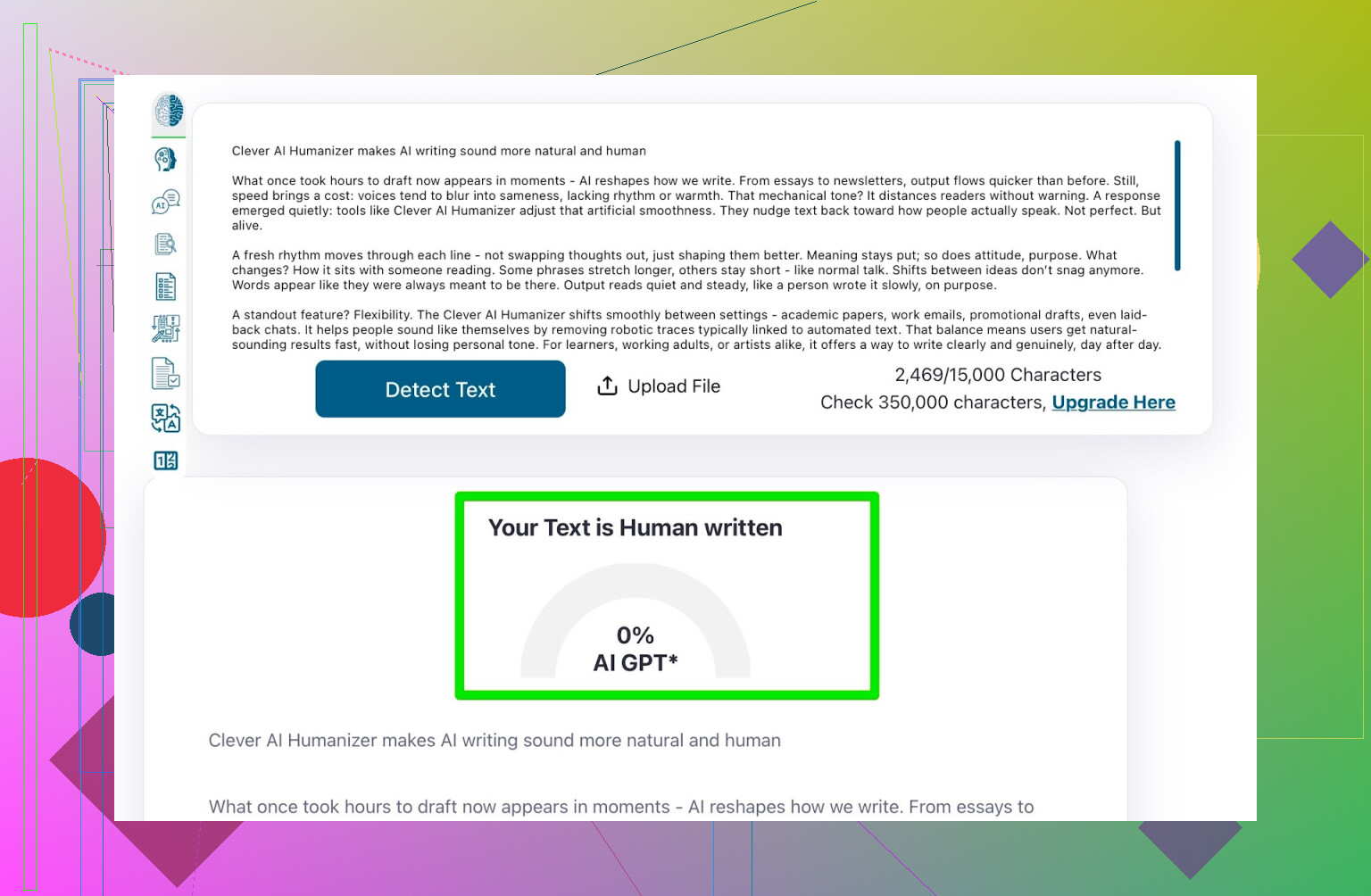

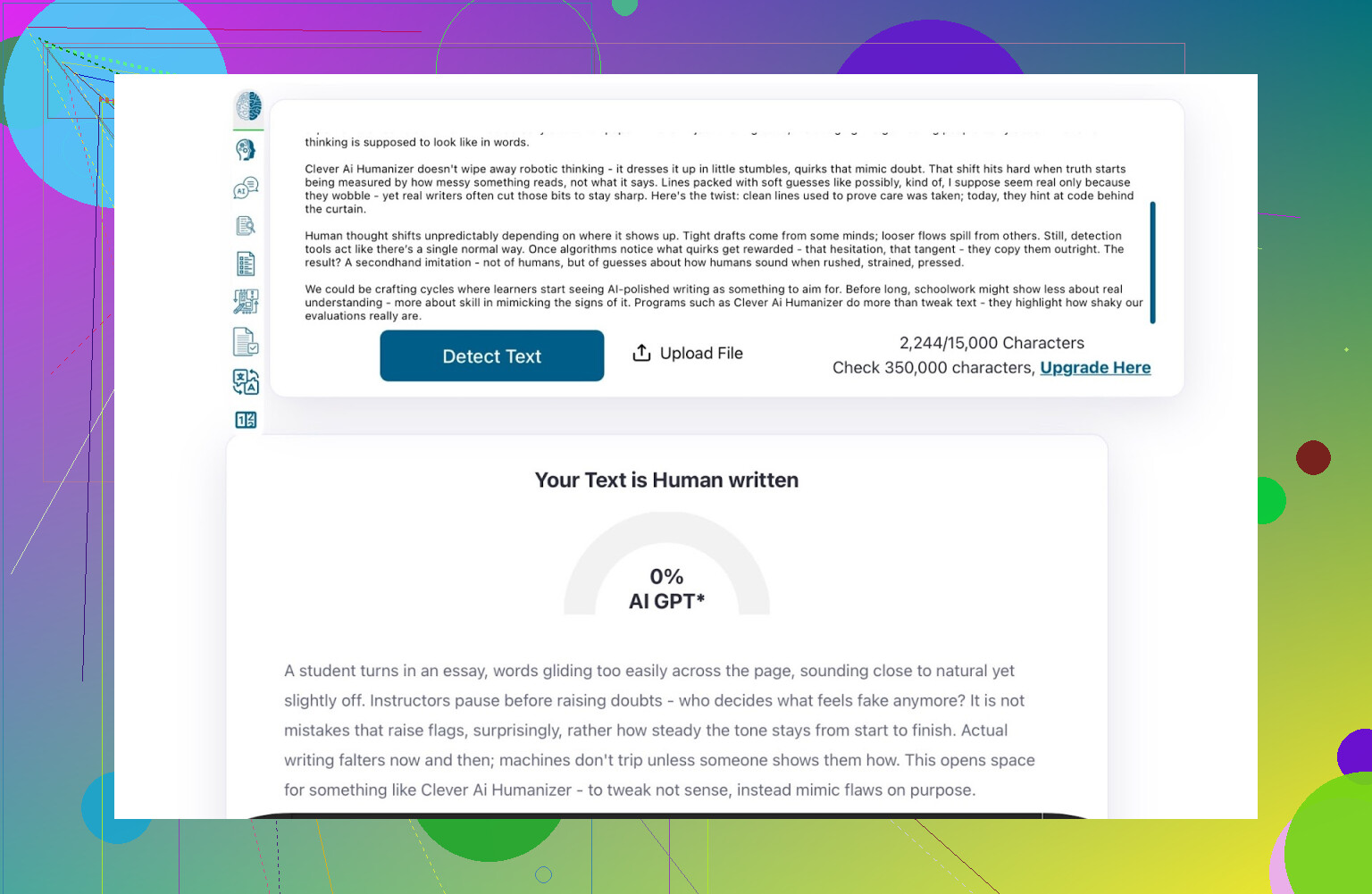

检测器测试:ZeroGPT

第一站:ZeroGPT。

老实说,我对这个工具的盲目信任度并不高——它曾经把美国宪法判成“100% AI”,这个操作相当离谱。但它的搜索量很大,很多老师和客户也在用,所以还是有参考价值。

对 Clever AI Humanizer 输出结果的检测:

- ZeroGPT:0% AI

ZeroGPT 判定为完全人类写作。

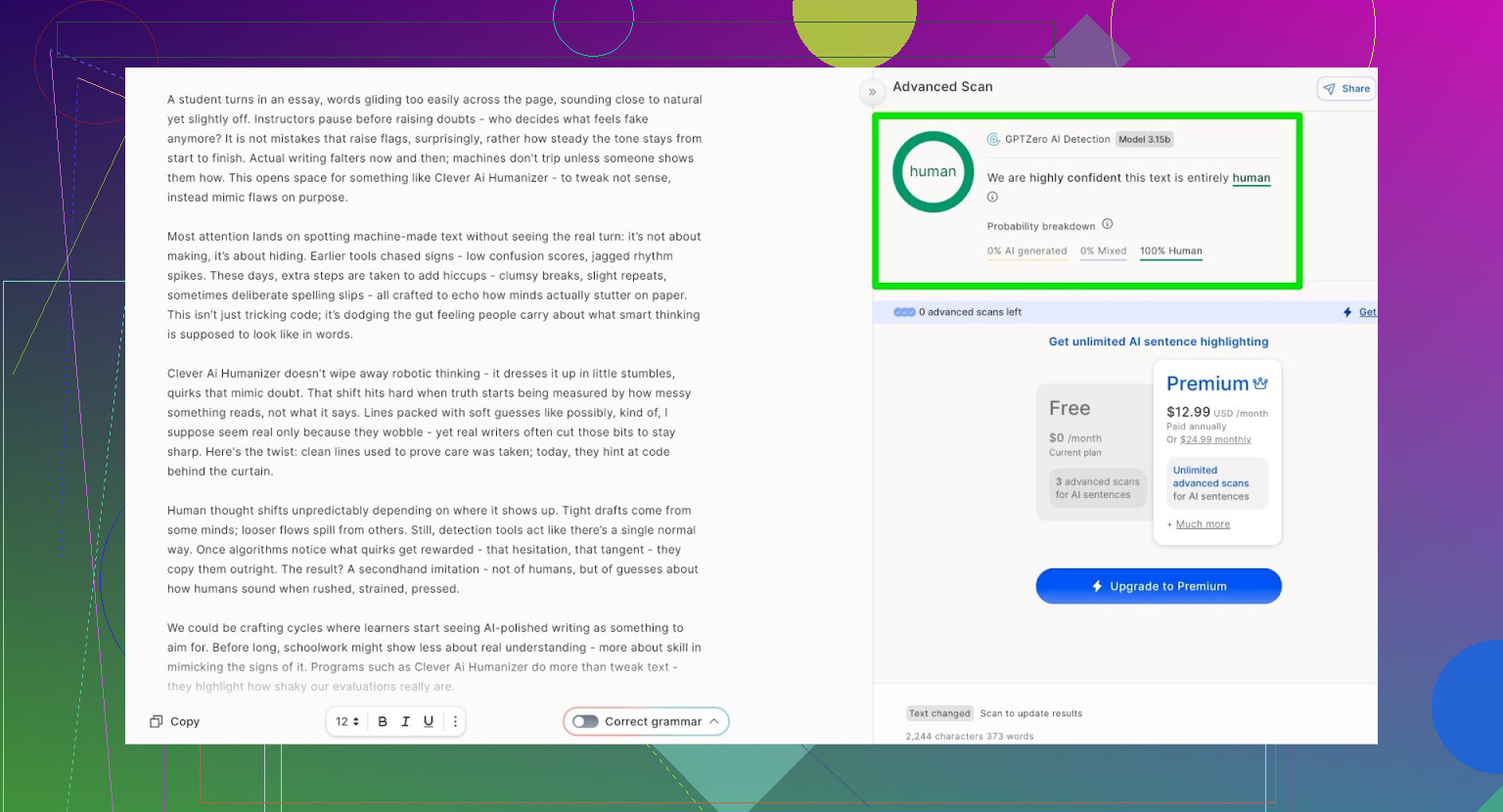

检测器测试:GPTZero

下一站:GPTZero,同样是非常常见的检测工具。

结果:

- GPTZero:100% human,0% AI

同样是纯人类文本的判定。

这些成绩看上去很漂亮,但检测器只是问题的一半。

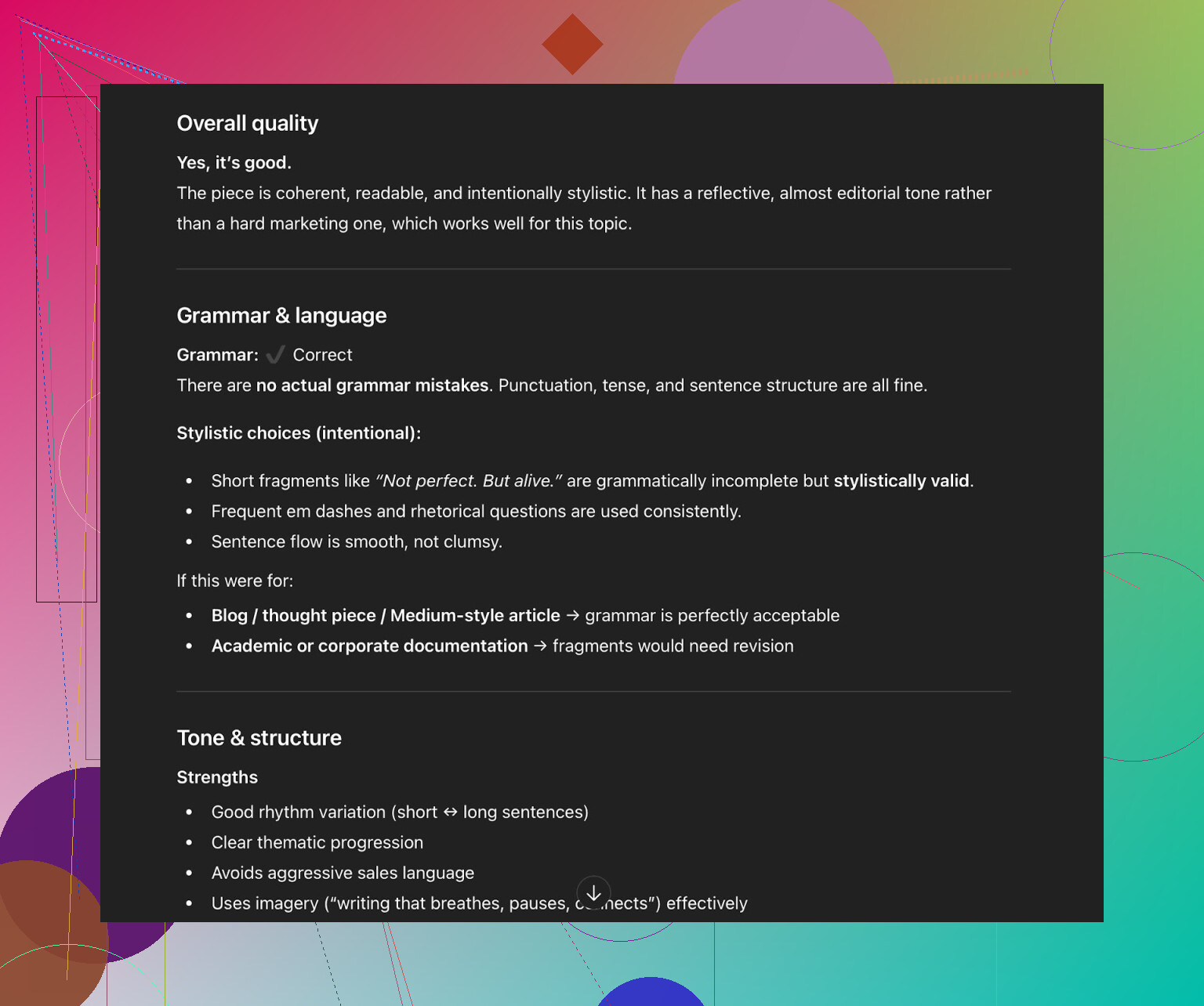

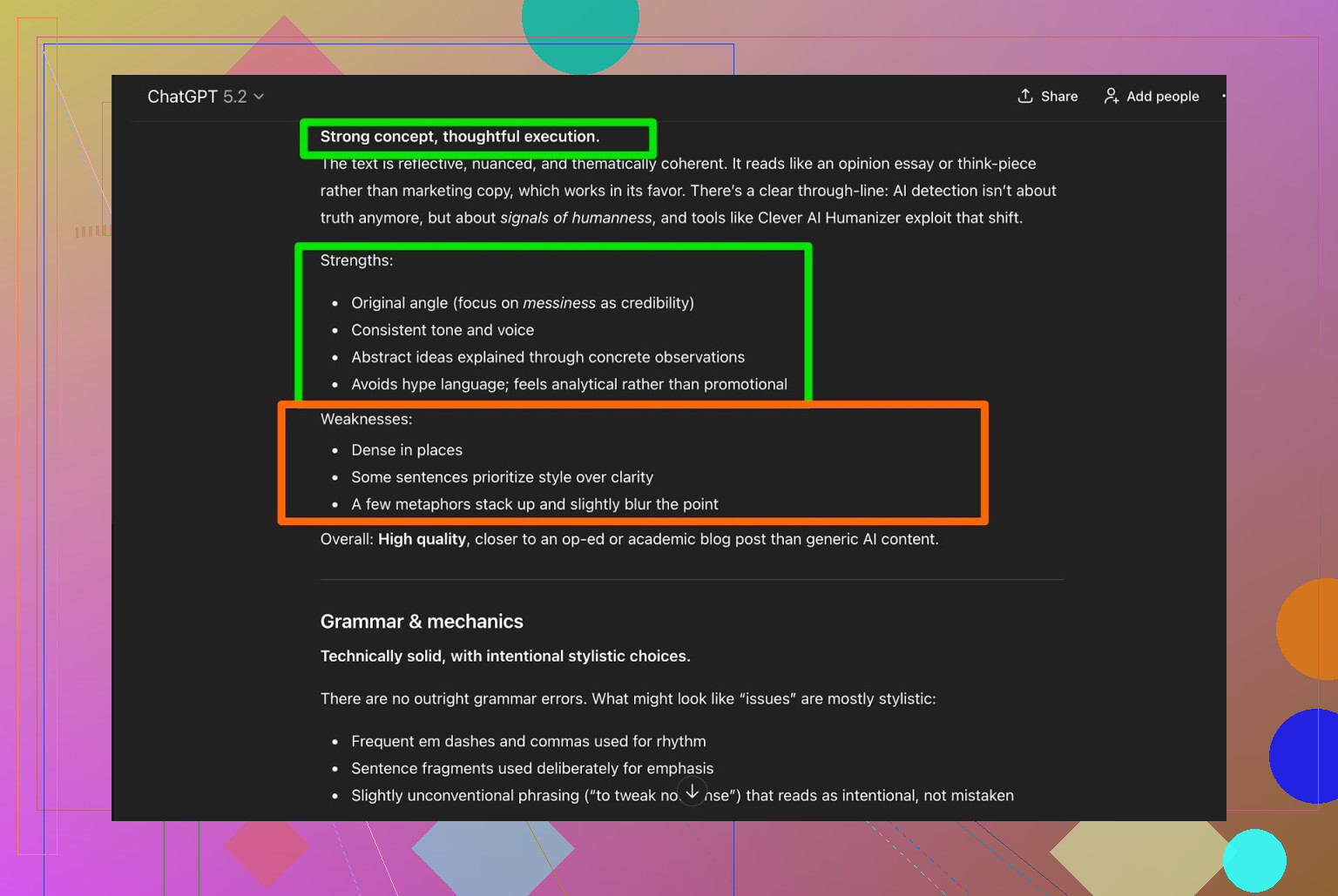

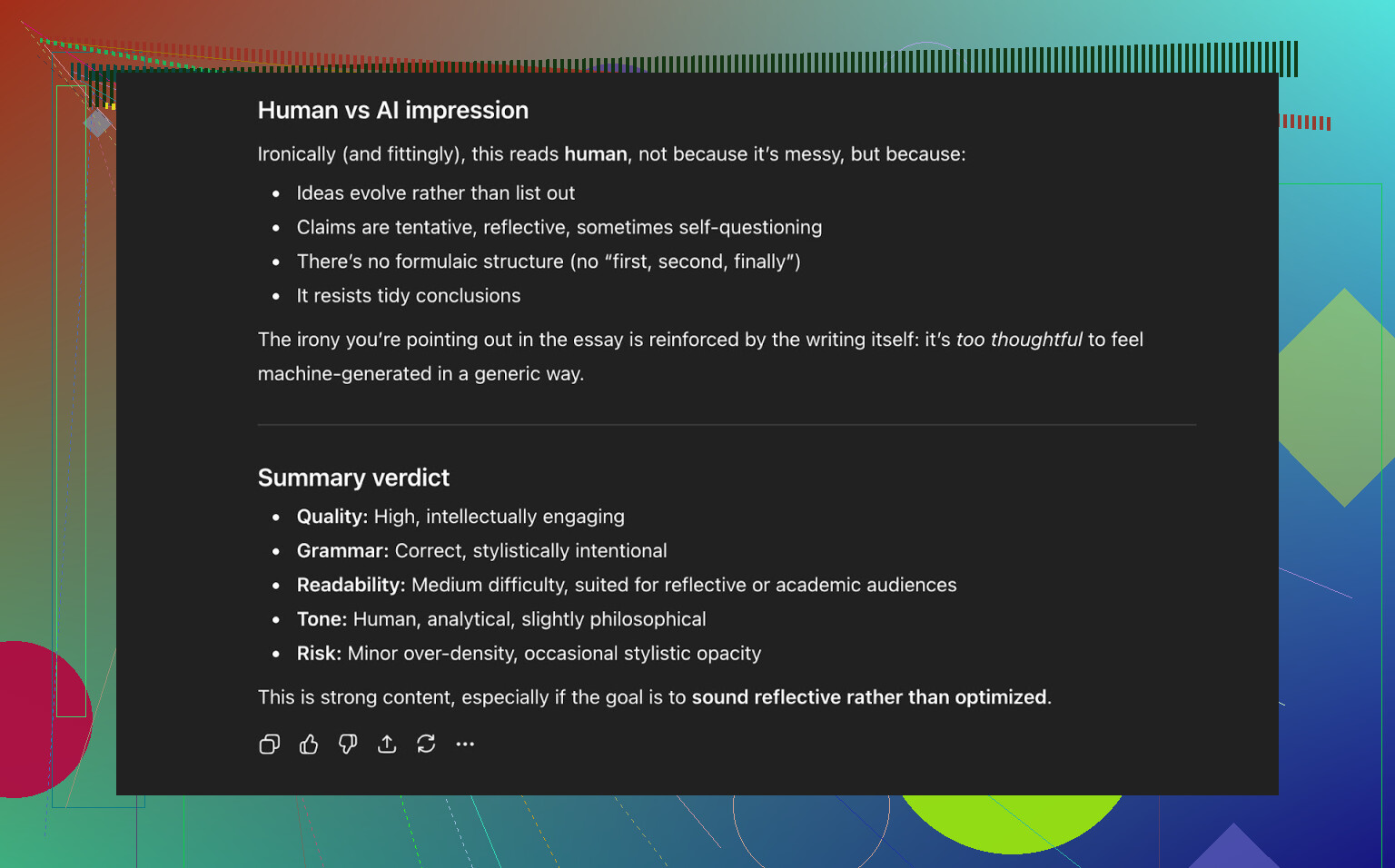

用 ChatGPT 5.2 做质量评估

绕过检测是一回事,把文本弄得别扭难读又是另一回事。

很多人性化工具确实能“骗过”检测器,但产出的文字读起来像是东拼西凑了五篇维基百科。

所以我把 Clever AI Humanizer 的输出又丢回 ChatGPT 5.2,让它:

- 做语法评估

- 评论行文流畅度和清晰度

- 判断整体看起来是否仍然像 AI 生成

总结出来的大意是:

- 语法:扎实

- 文风:比较贴合“Simple Academic”的定位

- 但仍然建议由人工做一次修订

这点我完全同意。

不管是人性化工具还是改写工具,只要是重要文本(作业、客户项目、求职材料等),人工最后一遍修改几乎是刚需。工具能帮你走到“差不多”,但替代不了人最后那一步。

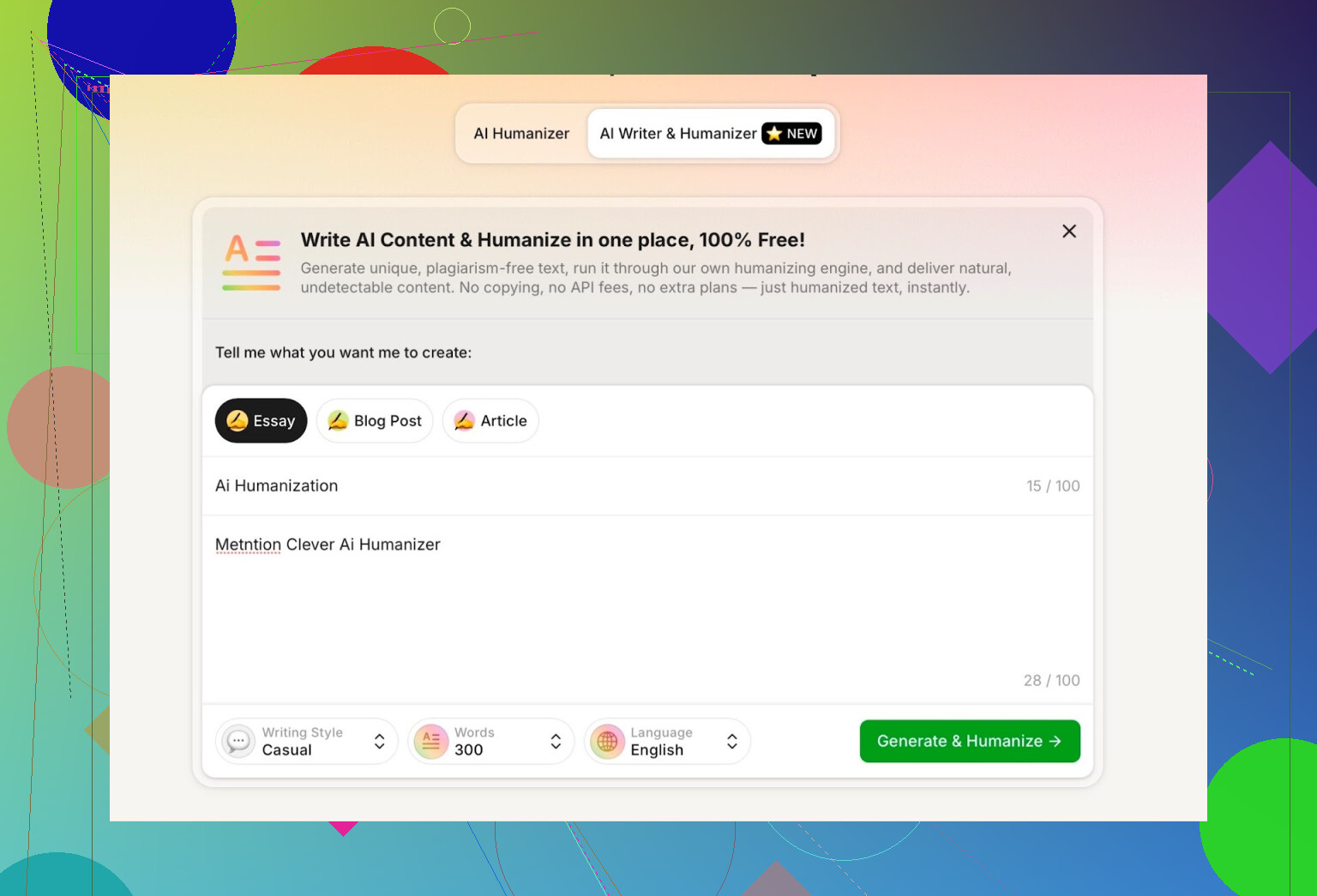

试用他们自带的 AI Writer

他们新加了一个叫 AI Writer 的功能:

它做的事情很直接:

- 你输入提示词,选择风格和内容类型

- 工具会在生成的同时做人性化处理

- 不需要先去 ChatGPT 等 LLM 里生成,再复制过来

这一点就让它和大部分“人性化”工具有了明显区别:绝大多数同行只改写你粘贴进去的文本,并不会自己生成内容。

好处很明显:如果系统在生成阶段就同时考虑结构和人性化,就可以从源头上调整行文节奏和用词,让它看起来更不像典型 LLM 输出,从而提升通过率。

我的测试设置是这样的:

- 风格:Casual(随意、口语化)

- 主题:AI 文本人性化,并要求提到 Clever AI Humanizer

- 我在提示词里故意写了一个错误,看看它怎么处理

有一点我不太满意:我要求了一个大致的字数(例如大概 300 词),结果它写超了不少。

如果我说 300 词,我希望接近 300,而不是明显多一大截。虽不致命,但算是第一个比较明确的负面点。

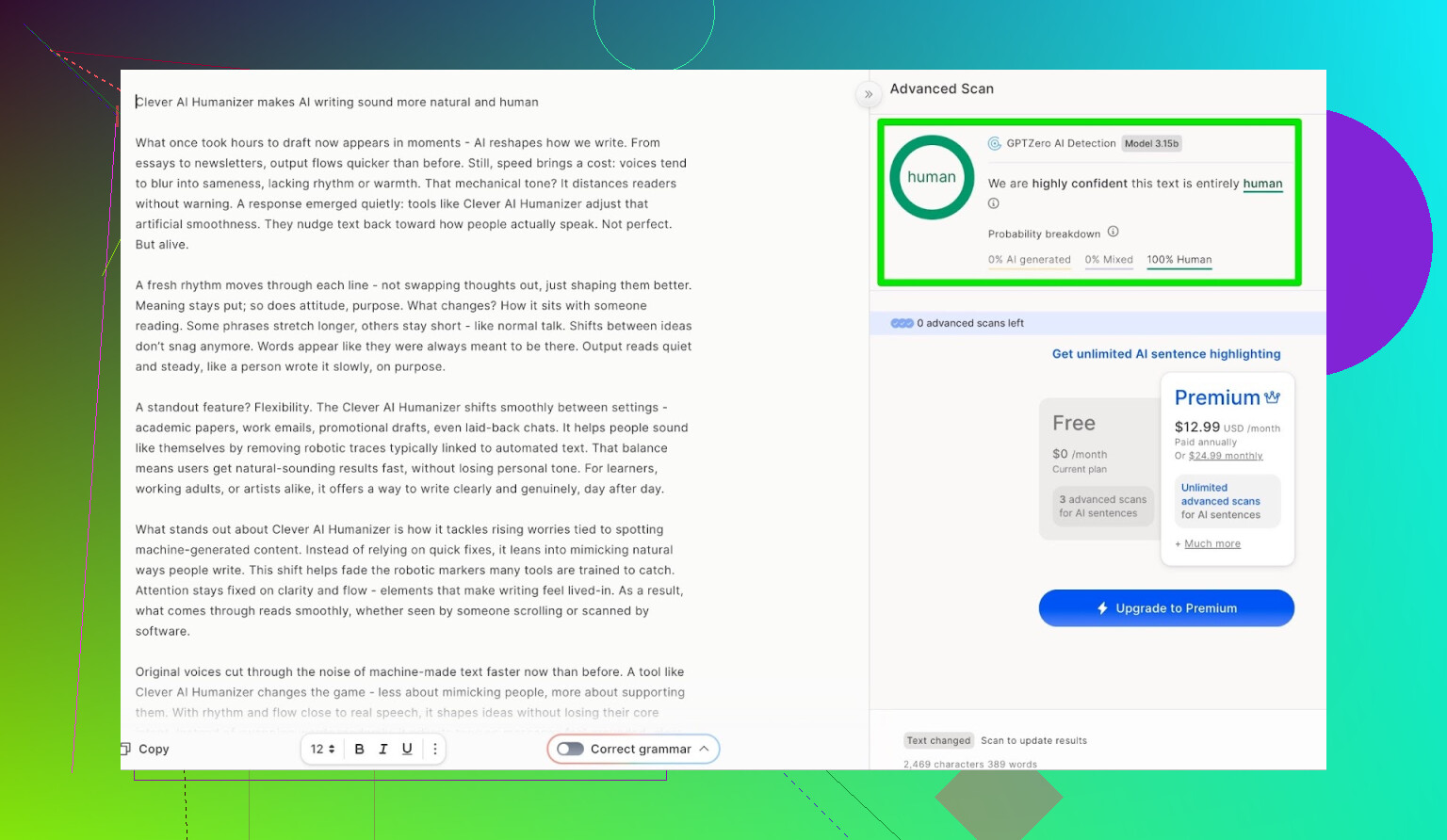

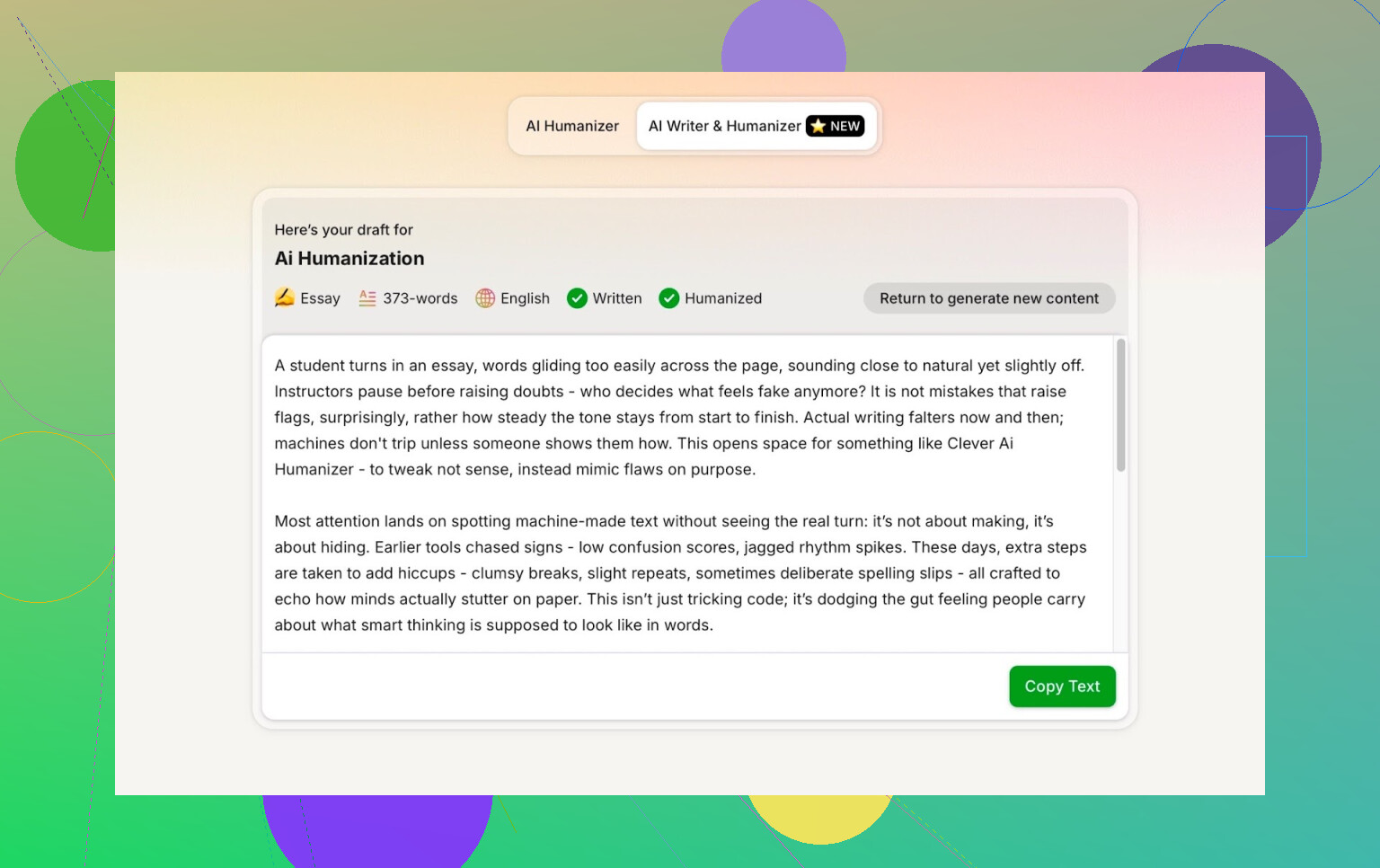

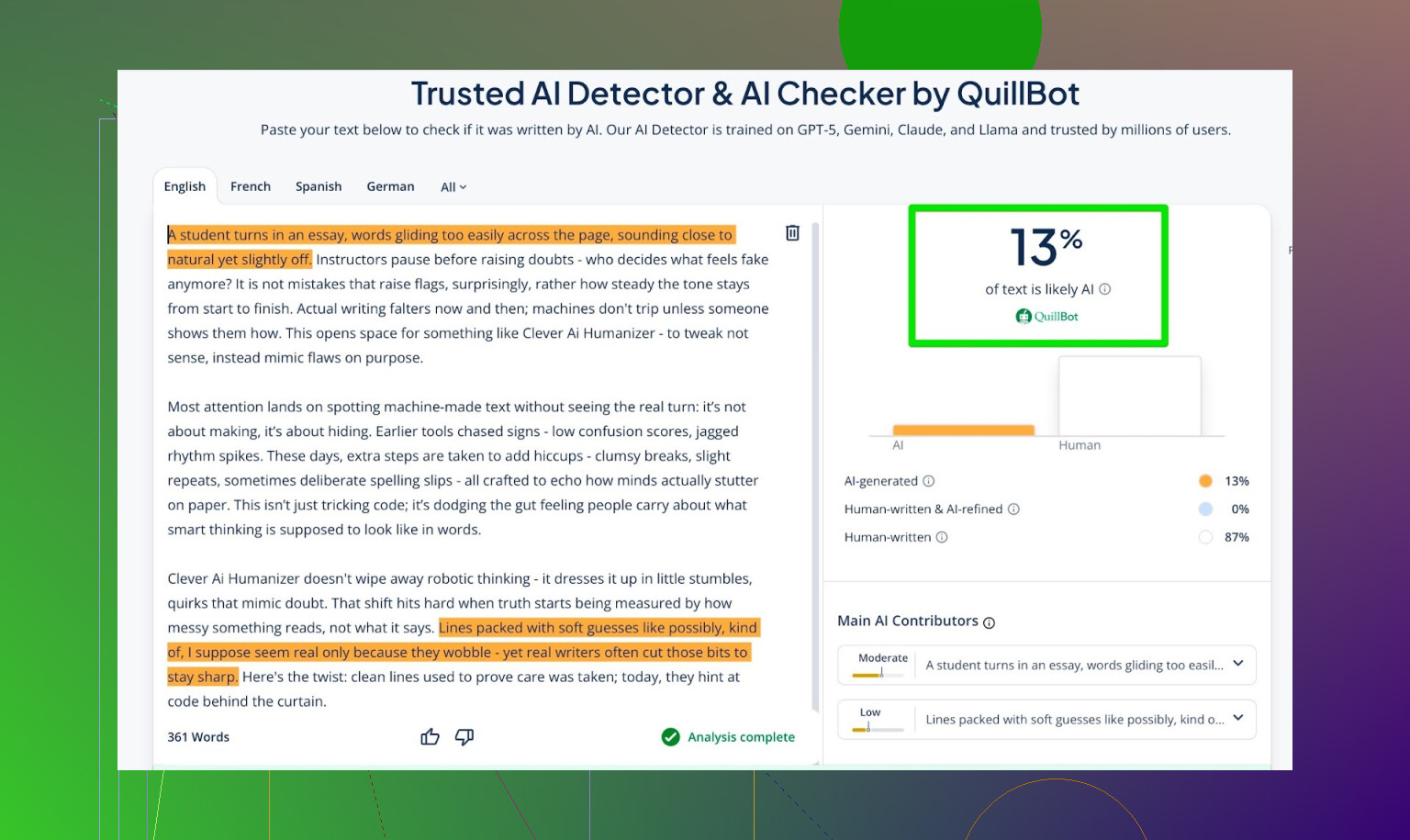

对 AI Writer 输出做检测

我按同样流程,把 AI Writer 生成的结果丢进多个检测器。

结果:

- GPTZero:0% AI

- ZeroGPT:0% AI(判为 100% human)

- QuillBot 检测器:13% AI

在现在这种检测器普遍“火力全开”的环境下,这一组数字已经相当不错了。

AI Writer 输出的文本质量

我也把 AI Writer 的结果交给 ChatGPT 5.2 再做一轮质检,重点看:

- 连贯性

- 语法

- “人类感”

总结下来:

- 读起来像是人写的

- 结构与行文节奏比较自然

- 用语中没有明显的 AI 痕迹或问题

所以在这轮测试里,Clever AI Humanizer:

- 在 ZeroGPT、GPTZero、QuillBot 中都拿到了不错的检测成绩

- 也让 ChatGPT 5.2 认为文本是人写的

以一个完全免费的工具来说,这样的表现并不常见。

和其他人性化工具的对比

我自己也拿它跟不少竞品做了对比测试,包括免费和付费的。

测试过的工具包括:

- Grammarly AI Humanizer

- UnAIMyText

- Ahrefs AI Humanizer

- Humanizer AI Pro

- Walter Writes AI

- StealthGPT

- Undetectable AI

- WriteHuman AI

- BypassGPT

下面是这些工具在我测试中,AI 检测得分的大致对比:

| Tool | Free | AI detector score |

| ⭐ Clever AI Humanizer | Yes | 6% |

| Grammarly AI Humanizer | Yes | 88% |

| UnAIMyText | Yes | 84% |

| Ahrefs AI Humanizer | Yes | 90% |

| Humanizer AI Pro | Limited | 79% |

| Walter Writes AI | No | 18% |

| StealthGPT | No | 14% |

| Undetectable AI | No | 11% |

| WriteHuman AI | No | 16% |

| BypassGPT | Limited | 22% |

按我目前的测试结果来看,如果只看免费工具,Clever AI Humanizer 基本是排在最前列的。

它有哪些不足

它并不是魔法棒,问题也有不少:

- 并不总能严格控制在你要求的字数范围内。

- 某些输出里,依然能看到可被检测的固定模式。

- 一些大模型在分析时,仍然有可能把部分段落判断为 AI 文本,这取决于提示词和篇幅。

- 偶尔会对原文的结构或内容改动偏大,超出你预期。

最后这一点大概也是它得分高的原因之一:改得越狠,就越不像常见的 AI 输出模式。

从语法角度:

- 我会给它打 8–9 分(满分 10 分)

- 多个语法检测工具和大模型给出的评价也大致相似

- 总体读起来顺畅,不太像“机翻式”的僵硬英文

有一点我挺欣赏:它不会搞那种“假装真人”的小伎俩,例如故意在全文里加错别字、写成 “i had to do it” 那种来迷惑检测器。的确,刻意引入错误有时可以降低 AI 判定概率,但同时也会让文本显得非常不专业。

Clever AI Humanizer 没有把“故意写错”当成卖点,这一点对我来说是加分项。

那种微妙的“AI 味”问题

即便所有检测结果都显示 0% AI,有时候你还是会感觉文本里有一股很轻微的“AI 节奏”。

很难精确描述,但如果你整天读 AI 生成内容,就会慢慢对这些模式变得敏感,例如:

- 句式重复度较高

- 段落结构过于平均、规整

- 转折与衔接略显平淡统一

在这方面,Clever AI Humanizer 比大多数免费工具做得好,确实打破了一些常见模式,但没法 100% 消除。到目前为止,没有任何一个工具能完全解决这个问题。

这也是整个领域的现状:检测器和人性化工具之间处在一种长期“猫捉老鼠”的拉扯里。

总结

如果你在找的是免费的 AI 文本人性化工具,Clever AI Humanizer 目前在我这边的定位是:

- 在规避检测方面非常强

- 可读性和语法表现也相当不错

- 明显强于一大堆只是“换个 Logo 就上线”的粗糙人性化站点

它是否完美?当然不是。

- 你还是需要自己再做一次人工编辑。

- 有时候字数会超出或者偏离你的预期。

- 某些输出依然会有一点点淡淡的 AI “后味”。

但从性价比角度看,当工具本身完全免费时,这些缺点就显得没那么难以接受。

把它当作一个起点,而不是终稿。

额外资源与 Reddit 讨论

如果你想更系统地了解其他 AI 人性化工具(附检测截图和横向对比),可以看这篇 Reddit 贴:

还有一个专门针对 Clever AI Humanizer 本身的讨论主题:

是的,“混合”这个词也正是我对 Clever AI Humanizer 的感觉。

对我来说,它对输入质量和风格选择非常敏感。给它特别泛泛的 AI 文本,再选个像“简单学术”这种风格,结果通常会更顺滑、更自然。但如果原文本身已经有很强的个人声音(比如很随意、带点吐槽、观点很重),Clever 有时会把一切都磨成同一种中度正式、略显平淡的语气。这个时候,即使检测工具觉得不错,人类读起来还是有点“AI 味”。

有几个具体的体验/使用点,可能能解释你遇到的情况:

-

结构很强,风格较弱

- 它在改顺拗口表达、让段落更通顺这块挺不错。

- 但在保留鲜明、独特的文风上就不太行。你丢进去一锅“重口味”,常常出来就只剩“清淡燕麦粥”了。

- 这大概也是为什么很多输出在技术上是“优化了”,但读起来还是有点怪。

-

检测分数 vs 人类直觉

- 能通过 GPTZero 或 ZeroGPT,不代表人类不会一眼看出 AI 味。

- 我碰到过那种检测显示“0% AI”的文本,但句子节奏很重复、段落结构也过于“均衡”。

- 所以如果你真的是写给真人读,光看检测分数是个很糟糕的指南针。

-

你得有点“提示工程”的意识

- 输入越短、越泛,它就越容易重写太狠,甚至偏离原意。

- 输入越长、结构越清晰,它就越守规矩,逻辑也更能保住。

- 我现在大多是拿它来改片段(2–4 段)而不是整篇文章,这样对语气的掌控会好很多。

-

后期人工编辑是刚需

- 我从不用 Clever AI Humanizer 的输出直接上任何严肃场景。

- 现在的流程是:

- 用自己喜欢的模型先生成一版

- 丢进 Clever AI Humanizer 选个风格跑一遍

- 做一次快速但有意识的人类修改:

- 换几处过于平滑或模板化的过渡

- 加两三句个人化的小插话或具体细节

- 删掉典型“AI 句子”,比如“总之,……”或“总体而言,需要注意的是……”

- 最后这 5–10 分钟的人工打磨,才是让它真正不那么“别扭”的关键。

-

我和 @mikeappsreviewer 稍微看法不同的地方

- 他们说它对免费工具来说已经很强、在检测上也挺稳,这点我同意。

- 但我不觉得它像他们截图里那样一直都很“自然”。只要话题有点细微差别或有比较强的立场,我会发现 Clever 很容易把情绪和锋芒都压扁。

- 另外,在我的测试里,它有时还会保留微妙的 AI 模式,比如每隔三句就来一个“然而,……”。检测工具可能不在意,但经常读 AI 文本的人一眼就会看出来。

-

它真正擅长的场景

- 清理那种平平无奇、明显是 AI 写的信息型内容(教程、解释类文章)。

- 做你准备之后再自己改一遍的“人性化初稿”。

- 不走那种靠刻意打错别字来骗检测工具的歪门邪道,至少语法大多还能保持干净。

-

它比较吃力的场景

- 强人格化的内容(吐槽、幽默、讲故事)。

- 特别死板的要求,比如“必须刚好 300 字”或极其严格的结构。

- 完全贴合某个具体人已经形成的独特文风。

如果你的目标是:“看起来没那么像原始 AI 文本,并且能通过基础检测”,那 Clever AI Humanizer 确实算是比较好用的免费选项,值得留在工具箱里。

如果你的目标是:“听起来就像某个具体的人,有非常鲜明的个人声音”,那现在还没有哪款 humanizer 真正能做到。Clever 可以帮你到一个还不错的基础稿,但你仍然得自己上手,把它“人为搞乱”:加点小岔开的话题,句子长短刻意不匀,多塞些具体的个人细节,甚至来一两个小小的风格怪癖或打错字 tyops 之类。

所以,你说效果“参差不齐”,和我的体验非常一致。我也会继续用 Clever AI Humanizer,只是会把它心里定位成一个很强的预编辑工具,而不是一键“完美拟人、以假乱真”的按钮。

是的,你那种“好坏参半”的体验,其实更贴近这些工具的真实表现,而不只是 Clever AI Humanizer 自身的问题。

我跟 @mikeappsreviewer 和 @sonhadordobosque 稍微有点不同看法的是:我不认为主要问题只是“输入质量”或者“只把它当作预编辑工具”。更大的问题在于:人们的预期,和这些工具真正被设计来做的事情之间严重不匹配。

Clever AI Humanizer 基本上是为这三件事做了优化:

- 打破常见的大模型写作模式

- 平滑语法和行文流畅度

- 让基础的 AI 检测工具不那么轻易判定为“100% AI”

它没有为这些目标做很好优化:

- 完整保留你的个人文风

- 在复杂论证上保持高度严密的逻辑

- 每一次都精准贴合某种非常具体的语气和风格

所以当你说“有时能提升流畅度和语气,有时就觉得很不对劲”,这其实正是它的 tradeoff 在起作用。它越是强力地打乱 AI 模式,就越有可能:

- 抹平个性

- 轻微扭曲重点或细微含义

- 把所有东西都变成那种“网上一个通用的聪明人”的腔调

我不会首先建议你换工具,而是会建议你改变使用 Clever AI Humanizer 的方式:

-

只让它处理特定部分

让它重写:- 事实性解释

- 背景介绍段落

- 各段之间的过渡段落

留给自己:

- 开头的 hook、引言、个人化的内容

- 有强烈立场的观点、故事、段子

只做这一点,就能大幅减少那种“哪里怪怪的”感受。

-

按“投放场景”而不是“写作气质”来选风格

如果是要给老师、客户或偏正式的场合看,“Simple Academic” 之类的就够用了。

对于博客或轻松的内容,这些模式会让文章显得太板正,像“穿了西装的 AI”。可以试试它更轻松的风格,然后你自己再针对每段挑 2–3 句做点手动润色。 -

预期你需要自己重新加回“人味儿的不完美”

Clever AI Humanizer 的文风很干净,甚至有点太干净。如果你想让文字更像真人,反而得自己动手:- 加一些过于具体的小细节

- 偶尔来一句很短的话,打破节奏

- 允许一两句话刻意写得有点长、有点绕

这种带点“乱七八糟”的人类感,现在没有哪家 humanizer 敢主动帮你加。

-

不要执着于每个检测器都拿到 0%

如果文章读起来自然,而检测器还显示有一点 AI 迹象,这可能反而是好事。在所有工具上都追求完美 0%,往往意味着文本被反复“揉捏”到变形,对真实读者来说反而很奇怪。我宁愿要“AI 评分低到中等 + 很有人味儿的读感”,也不要“0% AI + 过度平滑到诡异”。

综合 @mikeappsreviewer 和 @sonhadordobosque 的经验,我会这样总结:是的,Clever AI Humanizer 的确是目前比较好的免费选项之一,用来清理明显的 AI 痕迹也很靠谱。但如果你把它当成一键式的“让这篇文章完全看不出是 AI 写的”按钮,它多半会持续让你失望。

把它当作:

- 一个结构与检测的辅助工具,

- 然后再配合一次简短但有意识的人为修改,

在这样的用法下,Clever AI Humanizer 绝对值得留在你的工具组合里。只要别把你整套文风都丢给它,然后期望它原封不动地还给你就行。

你感受到的不一致并不是错觉。像 Clever AI Humanizer 这样的工具确实处在一个尴尬的中间地带:水平足以帮忙,但远不到可以闭眼完全信任的程度。

先不说更多测试,从用户体验 / 结果的角度来拆一下:

Clever AI Humanizer 的亮点

优点

- 操作阻力非常低:粘贴 → 选风格 → 完成。没有付费墙、也不要求账号,这一点就已经胜过一半竞品。

- 输出通常比直接用通用大模型生成的更干净,也不那么“LLM 模板味”,尤其是在简单学术或休闲风格下。

- 和主流检测器的兼容性还算不错,这也是为什么像 @mikeappsreviewer 这类评测者在横评里给它不低的评分。

- 不会为了“看起来更像人”而故意毁语法,不像有些工具会强行加入假错误。

它坑你的地方

缺点

- 语气漂移是真实存在的。你觉得“哪里怪怪的”,往往是因为它喜欢把所有内容统一压成一种默认的叙述声音,个人特色被抹平。

- 有时会重排逻辑或强调顺序。对于较细腻的内容,这种破坏比被检测器判定为 AI 还糟。

- 风格控制很浅。@sonhadordobosque 和 @shizuka 提到把它当预处理步骤,但更深层的问题在于:这些风格标签往往对不上你脑子里的预期。

- 几乎不能控制“改写幅度”。有时候你只想要 30% 的“去 AI 化”,它却给你来一次接近重写。

与其再说一遍“用完再手动改”的老话,不如换个思路,可能会让你的体验更稳定些:

-

先锁住你的个人文风,只人性化那些“无聊段落”

像平时一样写,或先用模型生成完整初稿。然后标记出以下类型的段落:- 纯解释性内容

- 概念/术语定义

- 背景 / 上下文介绍

只把这些段落丢进 Clever AI Humanizer。开头、结尾、故事、段子和笑点都不要动。这样可以减少语气割裂。

-

把它当“结构扰动器”,而不是润色终点

和 @mikeappsreviewer 有一点小分歧:我不建议把它当主力的行文优化工具。先由你自己或主模型做风格打磨,再用 Clever AI Humanizer 主要去打破那些一眼看出的 AI 句式痕迹。之后每一节再重新放回你原稿里两三句有味道的原句,找回个人声音。 -

在工具之外建立一套“自家文风模板”

既然它的风格系统比较粗糙,你可以旁边放一张极简检查表,比如:- 你希望的平均句长

- 第一人称出现的频率

- 是否允许反问句、俚语等

人性化处理完后,对照这张表快速扫一遍。这样体验会更可控,因为真正稳定的一致风格来自“你自己”,而不是工具。

-

事后不只校对错字,而是做“对比式编辑”

不要只盯着拼写和标点,刻意做几件小事:- 每段砍掉一条过长的句子,改短

- 每一节加一个特别具体的细节(时间、地点、数量、个人感受等)

- 每看到一次“在当今数字时代”这类空泛套话,就删掉一个

这些小小的反差,正是能打碎别人口中“AI 节奏感”的关键。

-

按风险等级选工具定位

- 低风险内容(博客草稿、内部文档):Clever AI Humanizer 作为快速一遍处理就够用,顺带享受一下检测器友好度。

- 高风险内容(学术、法律、敏感客户材料):只把它当“措辞建议库”。可以抄用它的好句子,但不要把结构控制权交给它。

再说说竞品与其他思路:

- 像 @sonhadordobosque 描述的那种路线,更偏向人工重写,安全但慢。

- @shizuka 把人性化工具当“预编辑过滤器”的想法是对的,不过在我看来,Clever AI Humanizer 更适合作为“模式打破器”,而不是普通意义上的改写工具。

- @mikeappsreviewer 那样系统化的测试很有价值,不过在日常使用里,你自己的“这还像我吗?”检查,比任何 0% 检测结果都更重要。

如果你把 Clever AI Humanizer 当作一个针对特定环节的小帮手,而不是万能修复剂,它的使用体验就不那么随机,更像一把专用扳手:对某些螺丝很好用,对另外一些则非常糟糕。